程垚松 | 中国科学院高能物理研究所计算中心 工程师

—— 本文收录于《话数 · 第3期》

【摘要】高能同步辐射光源(HEPS,High Energy Photon Source)是全球亮度最高的第四代同步辐射装置之一,其科学数据存储系统需满足EB级数据管理、高并发访问和长期保存的需求。本文系统地阐述了HEPS三层存储架构(线站存储、中心存储、磁带存储)的设计逻辑与技术方案。

一、引言

作为中国首个第四代同步辐射光源,高能同步辐射光源(HEPS)[1]已于2025年底完成建设并投入试运行,其亮度超越第三代光源千倍以上,达到国际第四代光源的领先水平。HEPS能够提供高达300keV的高能量、高亮度、高相干性等特点的同步辐射光,具备纳米(nm)量级空间分辨、皮秒(ps)量级时间分辨、毫电子伏(meV)量级能量分辨能力,可以为前沿基础科学和工业核心迫切需求的相关研究提供多维度、实时、原位的表征平台。

HEPS一期工程已建设 15 条光束线站,单条光束线每秒生成的多维实验数据峰值可达40 GB/s,预计每年累计生产原始数据超 300 PB [2]。先进的数据采集设备和海量实验数据对数据中心存储系统建设带来多项挑战:1)高性能读写,传统机械磁盘阵列的IOPS瓶颈难以满足毫秒级实验的实时写入,也难以支撑大规模AI算法训练的数据读写需求;2)稳定性和可靠性,大科学装置每一次实验取数机会都非常珍贵,需要确保100%完整地保存每次采集到的数据集,突发单点硬件故障不能影响整个系统的正常运行;3)兼容性,光源类实验装置由于每个光束线站的侧重点不同,与存储系统对接的应用也会有所差异,除了客户端平台差异(Unix、Windows、虚拟机、容器)还有多模态访问(实时处理/离线分析/数据沙箱)等复合型需求;4)基础设施成本,数据是重要的科研资产,在满足在线业务高并发读写需求的同时还要对原始数据进行长周期保存(>30年),单一存储介质通常都无法兼容高通量采集与低成本归档。

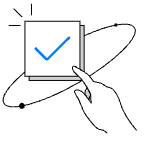

针对上述挑战,HEPS数据存储系统进行了针对性设计。首先,采用RoCE+TCP网络并行架构构建存储区域网,在提供高性能RDMA数据传输能力的同时,保障元数据通过TCP访问而不受干扰;其次,每一部分存储设施都要求具备足够的冗余配置,包括采用动态EC算法、分布式RAID、多副本、HA等技术;另外,所有存储系统都要求在兼容POSIX协议的基础上实现不同客户端平台间的数据访问权限同步和用户身份映射,以满足不同场景的访问需求;最后,我们建立了面向线站的高性能全闪存存储、位于数据中心的高密度磁盘存储与磁带库存储的三级物理存储层,实现数据分级策略。在保障热数据在线分析性能的同时提供高性价比、大容量的冷数据归档,如图1所示。

二、线站存储

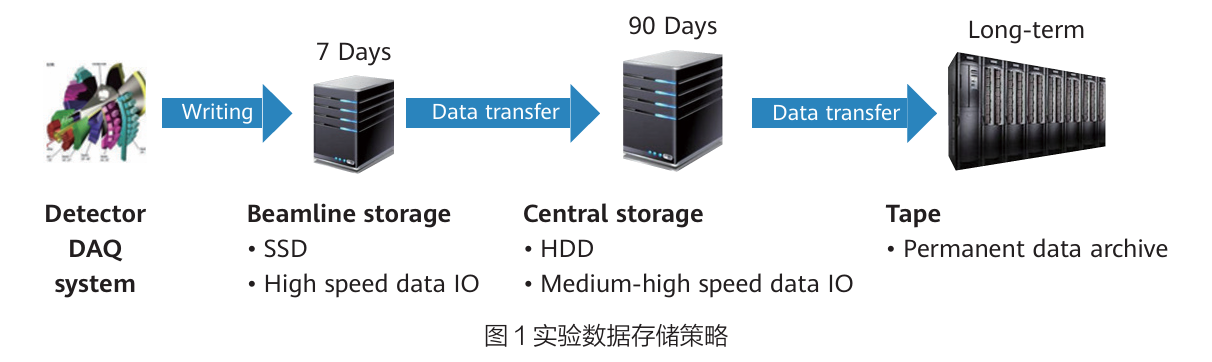

在HEPS存储系统设计中,线站存储作为数据采集与在线分析处理的关键缓冲层,需要低延时、高性能、兼容性强的数据基础设施支持。因此,我们在网络层采用传统以太网TCP和基于RDMA的RoCE网络的双链路并行架构,存储硬件方面选择NVMe SSD介质,并使用EC技术保障数据冗余和安全。经过充分调研和测试,最终部署一套4节点OceanStor Pacific 9920 分布式存储,每个存储节点配置25块 30.72 TB NVMe SSD。格式化后具有1.8 PB可用空间和800 GB/s访问带宽。存储系统采用双活集群架构,内置非易失性内存(NVDIMM)实现元数据持久化,将目录操作延迟从毫秒级压缩至微秒级。该系统采用全对称分布式架构OceanStor文件系统,对物理SSD进行虚拟化聚合。为突破传统存储客户端瓶颈,系统独创分布式并行处理客户端(DPC,Distributed Parallel Client),基于RoCEv2 网络协议实现用户态直接数据通路。DPC 可将单进程读写带宽提升至5 GB/s,并借助原子写操作、条带化数据分布等技术,确保多条光束线同时进行读写时的IOPS稳定在850万以上。本套系统使用fio测试读写性能,每台客户端均采用100Gb RoCE网络带宽配置,实测 5 台客户端聚合性能约 40 GB/s,具体如下:

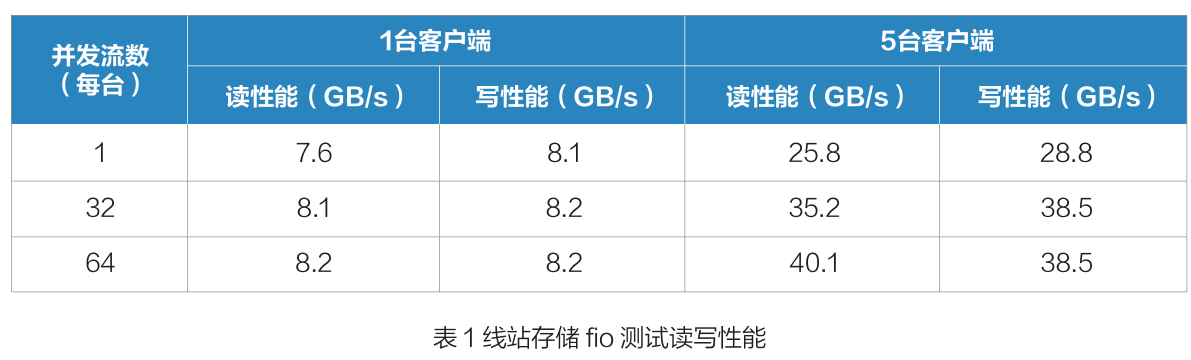

在NFS模式下,单个客户端仅通过TCP协议连接一个存储节点,仅支持POSIX接口且无法利用MPI-I/O并行优化,存在单节点带宽瓶颈;但在DPC模式下,客户端通过RDMA网络可以同时连接多个存储节点,支持POSIX/MPI-I/O 双接口,实现跨节点的并行数据聚合访问。DPC的核心优势在于通过 RDMA 零拷贝技术降低延迟、多节点条带化提升吞吐量,并借助MPI-I/O接口适配科学计算等场景的集体I/O需求,全面突破传统NFS在性能与扩展性上的限制。

另一方面,由于客户端环境多样性,例如不具备RDMA 网络的不同内核版本 Linux服务器、Windows 工作站等,我们同样需要NFS和CIFS协议的存储空间共享,同时确保每一个文件在不同终端的访问权限一致。OceanStor存储提供了无网关的本地、LDAP、AD 域控的用户权限映射,很好地保障了用户数据访问一致性。DPC 与传统 NFS的差异如图 2 所示。

三、中心存储

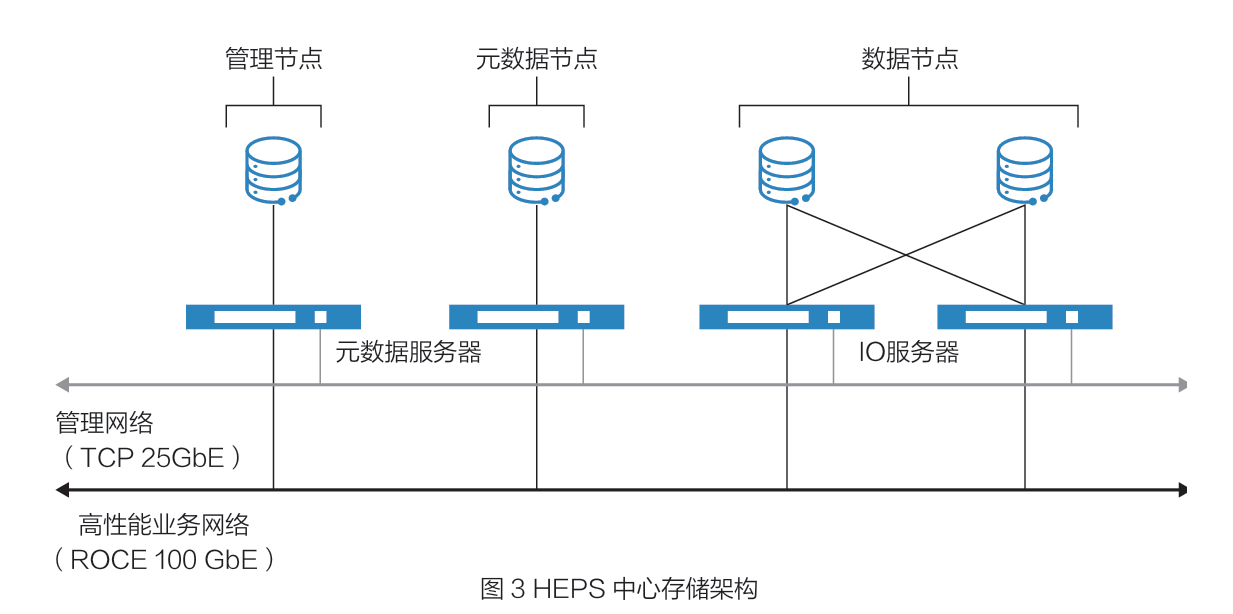

HEPS 一期的数据中心存储完成 29 PB可用空间建设,将提供较长时间的原始数据和模拟数据保存,并为离线数据分析提供中高速数据访问服务。在底层硬件上,兼顾 TCP 和RoCE 网络,采用高密度磁盘阵列和扩展柜提供高性价比的数据存储。为了保障数据的安全以及访问的稳定性,采用分布式 RAID 6 技术提供数据冗余,并在硬盘故障时尽快完成数据重建。

在文件系统层面,HEPS中心存储采用了并行文件系统,以其原生支持的并行 I/O 架构通过数据分片机制,高效处理海量读写请求,满足从中小规模到数千节点级集群的弹性扩展需求。其数据一致性保障机制融合了分布式锁管理、元数据强一致性验证、客户端缓存协同等核心技术。

在系统配置方面,使用 SSD 固态硬盘对元数据进行加速,来保障元数据的高效访问并分摊业务压力,采用主备服务节点的HA架构,使每个磁盘卷可以在两台IO服务器上灵活切换,以尽快恢复服务器级别的单点故障。在系统中还使用了多路由配置方式,使客户端可以选择 RoCE或TCP或两者兼顾的网络协议访问存储。但在数据中心设计中,主要采用RoCE 链路进行数据平面传输,TCP链路用于控制平面元数据交互。架构如图3所示。

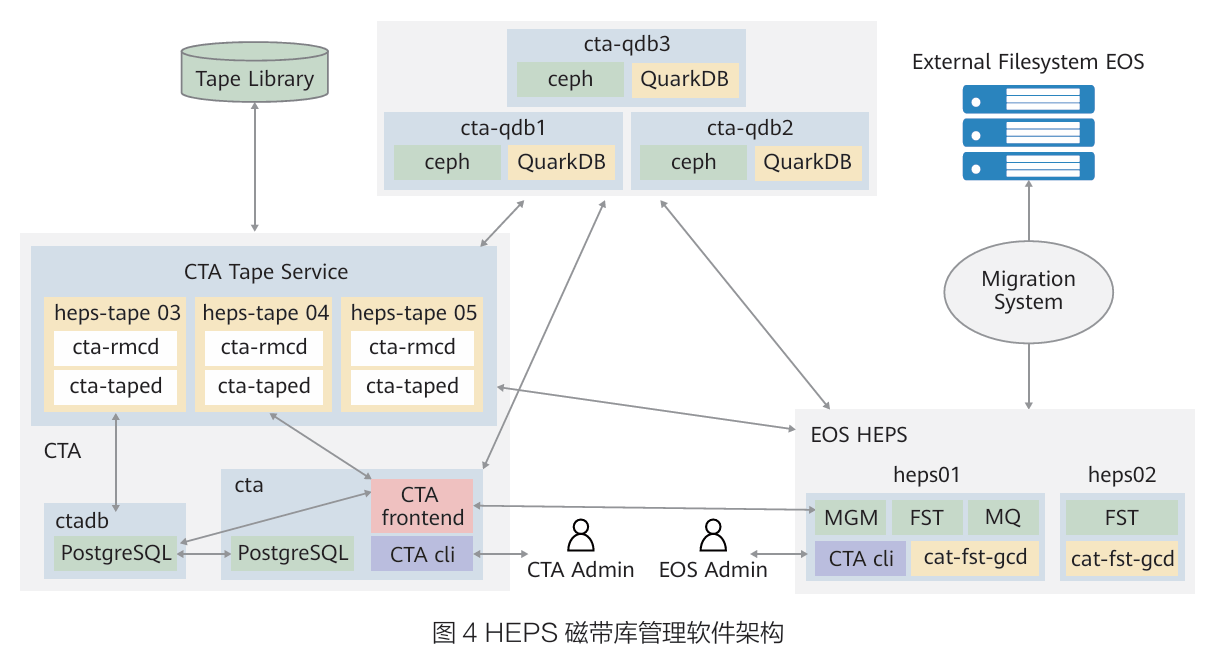

四、磁带存储

HEPS数据中心初期计划建设容纳50 PB 磁带介质的磁带库用于原始数据的长期保存。其基础设施由数据缓存磁盘阵列和磁带库构成。当原始数据在中心存储达到保存期限后将会由数据传输系统迁移至缓存阵列。磁带缓存部分采用欧洲核子研究中心 CERN 发布的开源分布式存储软件 EOS 进行管理,在整个数据生命周期中用以平衡磁带驱动器和磁盘存储的数据传输速度差异。磁带库部分采用 LTO 9 标准的磁带和驱动器,每块磁带可存放 15 TB 压缩数据,管理软件采用同样由 CERN 发布的开源磁带库管理软件 CTA,EOS-CTA架构如图 4 所示。

基于该管理系统,原始实验数据将分为双副本进行保存。该方案具备一定的核心优势,即:1)开源通用性,作为一款开源的通用磁带管理软件,EOS-CTA 架构具备高度可扩展性和兼容性,能够灵活适配不同规模的存储需求;2)高效管理能力,通过将 EOS 磁盘存储系统与 CTA 磁带管理模块结合,EOSCTA 提供了用户友好的界面和高效的数据管理方法,例如支持元数据与数据分离的架构设计,显著提升了数据迁移和访问效率,同时解决了传统磁带管理软件(如 Castor)的磁带卡顿、副本备份不全等问题;3)领域适配性,因其原生支持高能物理领域广泛使用的 XRootD 协议,并与 ROOT 分析框架深度集成,EOS-CTA 已成为高能物理实验(如CERN 的 HL-LHC、高能所的 LHAASO 等)中主流的存储解决方案,能够支撑 PB 至 EB级数据的长期存储和稳定服务。此外,HEPS未来还计划建设异地容灾磁带库,更充分的保障原始数据的安全。

五、结语

当前建设的 HEPS 存储系统距离完全承载 HEPS 产生的海量数据还有很大的扩展潜力。未来我们将进一步优化性能、保障数据安全、提供更稳定的访问。同时,我们也将运用新的人工智能技术开发系统异常检测、流量控制、作业行为分析等功能,提升系统运维效率和用户使用体验。

参考文献:

[1] Y. Jiao, W. Pan, High Energy Photon Source. High Power Laser and Particle Beams. 34, 10(2022)

[2] H. Hu, HEPS Data and Computing System. Synchrotron Radiation News. 37, 6